در حال خواندن: مایکروسافت از چیپ هوش مصنوعی Maia 200 رونمایی کرد؛ گام بزرگ برای کاهش هزینه و رقابت مستقیم با انویدیا

-

01

مایکروسافت از چیپ هوش مصنوعی Maia 200 رونمایی کرد؛ گام بزرگ برای کاهش هزینه و رقابت مستقیم با انویدیا

- خانه

- دسته بندی ها

- اخبار

- مایکروسافت از چیپ هوش مصنوعی Maia 200 رونمایی کرد؛ گام بزرگ برای کاهش هزینه و رقابت مستقیم با انویدیا

مایکروسافت از چیپ هوش مصنوعی Maia 200 رونمایی کرد؛ گام بزرگ برای کاهش هزینه و رقابت مستقیم با انویدیا

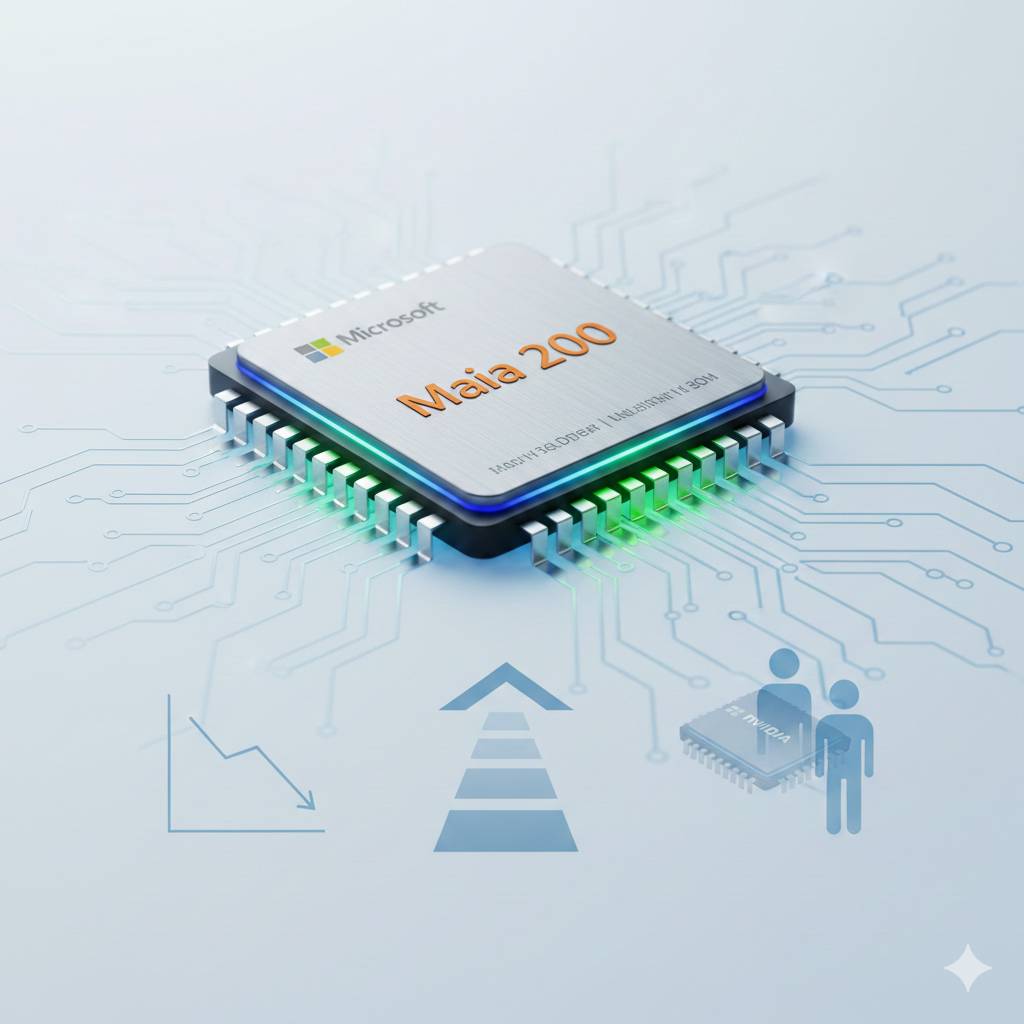

مایکروسافت بهطور رسمی از نسل جدید چیپ اختصاصی هوش مصنوعی خود با نام Maia 200 رونمایی کرد؛ پردازندهای که به گفته این شرکت، برای پاسخگویی سریعتر مدلهای هوش مصنوعی و کاهش چشمگیر هزینههای پردازش طراحی شده و قرار است نقش کلیدی در آینده سرویسهای هوش مصنوعی Azure، Copilot و مدلهای زبانی بزرگ ایفا کند.

این چیپ که تمرکز اصلی آن بر پردازش Inference (مرحله تولید پاسخ توسط مدلهای هوش مصنوعی) است، بخشی از استراتژی کلان مایکروسافت برای کاهش وابستگی به سختافزارهای شرکت انویدیا و کنترل بهتر هزینههای رو به رشد زیرساختهای AI محسوب میشود؛ هزینههایی که با گسترش استفاده از مدلهای بزرگ زبانی، به یکی از چالشهای اصلی غولهای فناوری تبدیل شدهاند.

تمرکز بر قلب پرهزینه هوش مصنوعی

در حالی که بسیاری از پردازندههای AI بر مرحله «آموزش مدل» تمرکز دارند، مایکروسافت در Maia 200 مسیر متفاوتی را انتخاب کرده است. به گفته مدیران این شرکت، بیشترین فشار مالی و مصرف انرژی در سرویسهای هوش مصنوعی، نه در آموزش اولیه مدلها، بلکه در مرحله پاسخدهی روزانه به میلیونها کاربر اتفاق میافتد.در حالی که بسیاری از پردازندههای AI بر مرحله «آموزش مدل» تمرکز دارند، مایکروسافت در Maia 200 مسیر متفاوتی را انتخاب کرده است. به گفته مدیران این شرکت، بیشترین فشار مالی و مصرف انرژی در سرویسهای هوش مصنوعی، نه در آموزش اولیه مدلها، بلکه در مرحله پاسخدهی روزانه به میلیونها کاربر اتفاق میافتد.

مایکروسافت اعلام کرده Maia 200 دقیقاً برای همین نقطه طراحی شده است؛ جایی که هر درخواست کاربر، نیازمند پردازش سریع، پایدار و کمهزینه است. این رویکرد بهویژه برای سرویسهایی مانند Microsoft 365 Copilot، Azure OpenAI Service و اجرای مدلهای نسل جدید GPT اهمیت بالایی دارد.

مشخصات فنی پیشرفته با تمرکز بر کارایی

چیپ Maia 200 با استفاده از فناوری ساخت ۳ نانومتری تولید شده و از نظر توان پردازشی در رده پیشرفتهترین سختافزارهای هوش مصنوعی قرار میگیرد. این پردازنده قادر است در حالتهای محاسباتی مدرن مورد استفاده در مدلهای زبانی، به توان چندین پتافلاپس دست یابد؛ موضوعی که اجرای مدلهای بزرگ را با سرعت بالا ممکن میسازد.

از نظر حافظه نیز Maia 200 به بیش از ۲۰۰ گیگابایت حافظه HBM3e مجهز شده که پهنای باند بسیار بالایی را در اختیار چیپ قرار میدهد. این ویژگی بهطور مستقیم باعث کاهش تأخیر در پاسخدهی مدلها و افزایش پایداری سرویسهای مبتنی بر AI میشود؛ عاملی حیاتی برای کاربردهای سازمانی و تجاری.

مایکروسافت همچنین اعلام کرده که طراحی داخلی چیپ بهگونهای انجام شده که دادههای پرتکرار و حساس، در سریعترین مسیر ممکن به واحدهای پردازشی برسند؛ موضوعی که نقش مهمی در بهینهسازی مصرف انرژی دارد.

کاهش هزینه؛ هدف اصلی Maia 200

یکی از کلیدیترین وعدههای مایکروسافت درباره Maia 200، کاهش هزینه پردازش هر توکن است؛ معیاری که بهطور مستقیم بر قیمت نهایی سرویسهای هوش مصنوعی اثر میگذارد. بر اساس اعلام رسمی این شرکت، استفاده از Maia 200 میتواند هزینه اجرای مدلهای AI را تا دهها درصد کاهش دهد.

این موضوع برای مایکروسافت اهمیت راهبردی دارد، چرا که رقابت در بازار هوش مصنوعی تنها به قدرت مدلها محدود نمیشود، بلکه قیمت و مقیاسپذیری نیز نقش تعیینکنندهای در جذب مشتریان سازمانی ایفا میکند.

یکی از مدیران ارشد مایکروسافت در اینباره گفته است:

«برای اینکه هوش مصنوعی در مقیاس جهانی پایدار باشد، باید هزینهی هر پاسخ کاهش پیدا کند. Maia 200 به ما کمک میکند AI را هم سریعتر و هم مقرونبهصرفهتر ارائه دهیم.»

زیرساخت اختصاصی برای Azure و Copilot

بر اساس اعلام مایکروسافت، چیپ Maia 200 در مرحله نخست در دیتاسنترهای Azure در ایالات متحده مستقر میشود و بهتدریج در سایر مناطق نیز گسترش خواهد یافت. این چیپ بهطور مستقیم در پشتصحنه سرویسهای مبتنی بر هوش مصنوعی مایکروسافت مورد استفاده قرار میگیرد و کاربران نهایی بدون تغییر ظاهری، بهبود سرعت و کیفیت را تجربه خواهند کرد.

سرویسهایی مانند Copilot در مجموعه Microsoft 365، ابزارهای توسعهدهندگان در Azure AI Foundry و همچنین اجرای مدلهای پیشرفته زبانی از جمله GPT، از نخستین بهرهبرداران این سختافزار جدید خواهند بود.

مایکروسافت تأکید کرده که Maia 200 صرفاً یک محصول سختافزاری نیست، بلکه بخشی از یک اکوسیستم کامل نرمافزاری است که با ابزارهای محبوب توسعهدهندگان سازگاری کامل دارد و امکان بهینهسازی مدلها برای این چیپ را فراهم میکند.

رقابت مستقیم با انویدیا و آمازون

رونمایی از Maia 200 را میتوان بخشی از موج جدید طراحی چیپهای اختصاصی توسط شرکتهای بزرگ فناوری دانست. در سالهای اخیر، وابستگی شدید به پردازندههای انویدیا به یکی از نگرانیهای اصلی این شرکتها تبدیل شده و حالا هر کدام تلاش میکنند کنترل بیشتری بر زنجیره تأمین و هزینههای خود داشته باشند.

پیامدها برای آینده هوش مصنوعی

رونمایی از Maia 200 تنها یک خبر فنی نیست، بلکه نشانهای از تغییر مسیر صنعت هوش مصنوعی بهسوی بهینهسازی اقتصادی است. با گسترش استفاده از AI در زندگی روزمره، فشار برای ارائه پاسخهای سریعتر، ارزانتر و پایدارتر افزایش یافته و شرکتها ناچارند بهدنبال راهکارهای جدید باشند.

مایکروسافت با سرمایهگذاری سنگین روی سختافزار اختصاصی، نشان داده که هوش مصنوعی را نه یک ویژگی جانبی، بلکه هسته اصلی آینده محصولات خود میداند. مسیری که احتمالاً در سالهای آینده با معرفی نسلهای جدیدتر Maia ادامه پیدا خواهد کرد.

در مجموع، Maia 200 را میتوان یکی از مهمترین تحولات اخیر در زیرساختهای هوش مصنوعی دانست؛ چیپی که اگر انتظارات را برآورده کند، نهتنها جایگاه مایکروسافت در بازار AI را تقویت میکند، بلکه میتواند بر قیمت، دسترسی و آینده استفاده از هوش مصنوعی در مقیاس جهانی اثرگذار باشد.

پستهای مرتبط

با آخرین و مهمترین اخبار بهروز بمانید

You need to configure your Mailchimp API key for this form to work properly.